Apple 股價跳漲 7%!深挖兩份低調的資料後,我們發現了蘋果 AI 的秘密

AI 2024.06.14

蘋果自研的 AI 模型能力強大,既有端側小模型,也有雲端大模型。Apple Intelligence 完全由蘋果自研模型支持,與 OpenAI 獨立運作。

重點有兩個:

- 蘋果自研大模型的能力很強;

- OpenAI 並沒有為 Apple Intelligence 提供支持,兩者完全獨立。Apple Intelligence 完全由 Apple 自研模型提供支持。

深挖蘋果發布的模型技術文件:兩個新確定的資訊,可能才是這次發布最重要的點

1、蘋果低調發布了自研模型:不僅有端側的小模型,還有雲端端大模型

在 Keynote 上,蘋果一直在講擁有了 AI 能力的端側設備,能帶給使用者多麼神奇的應用體驗。但是這些模型到底是誰家的?哪些是蘋果自研的,哪些是和 OpenAI 合作的?雖然承諾了隱私安全,但是究竟具體如何保障?馬斯克連發推怒懟蘋果如果整合了 OpenAI,將在公司禁用蘋果。但是蘋果整場主題演講下來,我們都沒找到明確答案。

在 Keynote 發布會後,它發布了一篇技術部落格,並在 State of Union 上公佈了它會在蘋果設備上用的模型細節:端和雲端模型,都是蘋果自己開發的。

2、自研大模型趕上 GPT-4

具體來看,蘋果設備上的端側模型是一個 30 億參數(3B)的小模型,雲端上模型具體參數蘋果沒有公佈。這兩個模型的性能都相當能打。

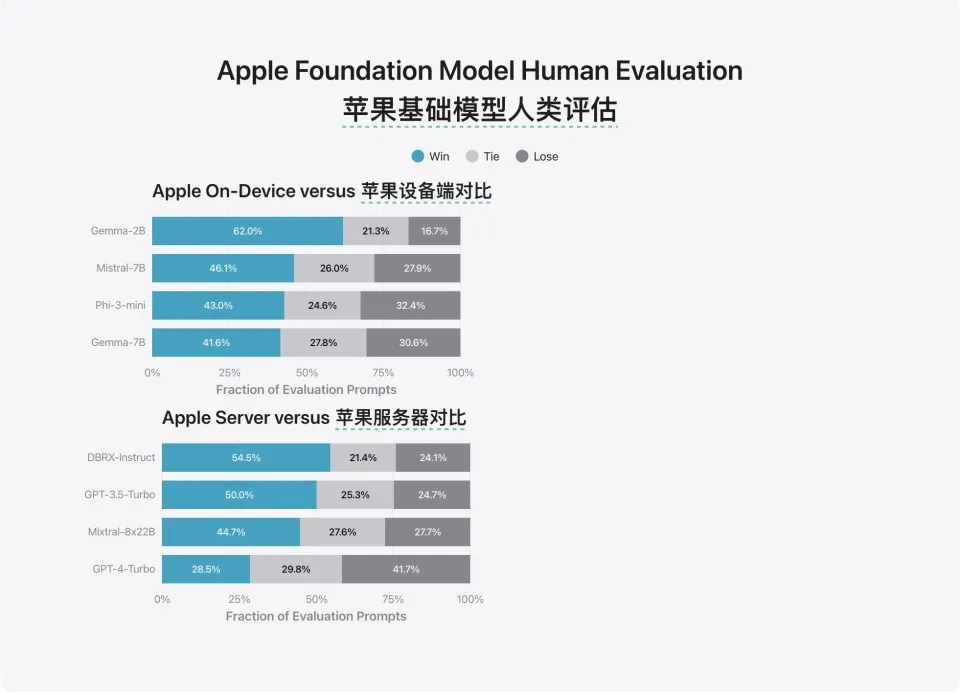

3B 級小模型和主流幾個 7B 級模型能力上蘋果都能基本勝出(勝出+平手機率 > 50%)。而其雲端端模型則直接打到了 GPT-4 Turbo 級(勝出+平手機率 58.3%)。

這一發布可能才是整個蘋果這波更新裡最大的核彈:蘋果自研出了 GPT4 級大模型,而且一出場就已經成熟到可以直接接入蘋果的軟硬體設備體係內了。

這意味著之前對蘋果模型能力的質疑完全不成立。蘋果現在不用依靠外部模型公司就能構建出自己內部閉環的 AI 系統。這是除了 Google 之外的其它手機廠商當下完全無法做到的。

這就是蘋果把 OpenAI 只列為之一,而且是作為外部調用的模型之一的底氣。

端側小模型強優化

另外說說端側模型,在發布會上蘋果強調大多數 Apple Intelligents 的操作都會在端側模型上完成。但在發布會後所有人幾乎都在質疑,一個 3B 大小的模型是不是能真的完成發布會上展示的那些功能。

首先,3B 大小的端側模型落地其實已經很不容易了。

看看蘋果的競品們的表現吧:Google 在去年 12 月首次把其端側模型 Gemini Nano 部署到旗艦手機 Pixel 8 Pro 上,它的參數大小不過是 1.8B,而且能力非常局限。三星 S24 在端側也用的是 Gemini Nano。要知道 Pixel 8 Pro 具有 12G 內存,直到今年 5 月 Google 剛剛才能讓 8G 內存的 Pixel 8 和 8a 也跑上這個 1.8B 的模型,還要下個月才能真正升級部署。而其它手機廠商部署的端側模型基本上都是在 1B 級別的參數規模。

而蘋果做到了讓自己 8G 內存的 iPhone 15 Pro 跑起來一個 3B 參數的模型。這工程能力就甩出競爭對手一個身位。

在這之前,蘋果已經為此做足了準備,在去年 12 月引起轟動的論文《LLM in a flash: Efficient Large Language Model Inference with Limited Memory》裡,蘋果就提出了解決小內存運行大模型的方法,使用窗口化(Windowing)以及行列捆綁(Row-Column Bundling)兩項關鍵技術,來最小化數據傳輸和最大化閃存吞吐量。

在這次的技術文件中,蘋果還提到了他們在模型架構中用上了分組注意力查詢(grouped-query-attention)和 LoRA 適應器架構。這兩項技術一個避免重複映射,一個可以壓縮推理過程,都可以有效降低內存佔用和推理成本。

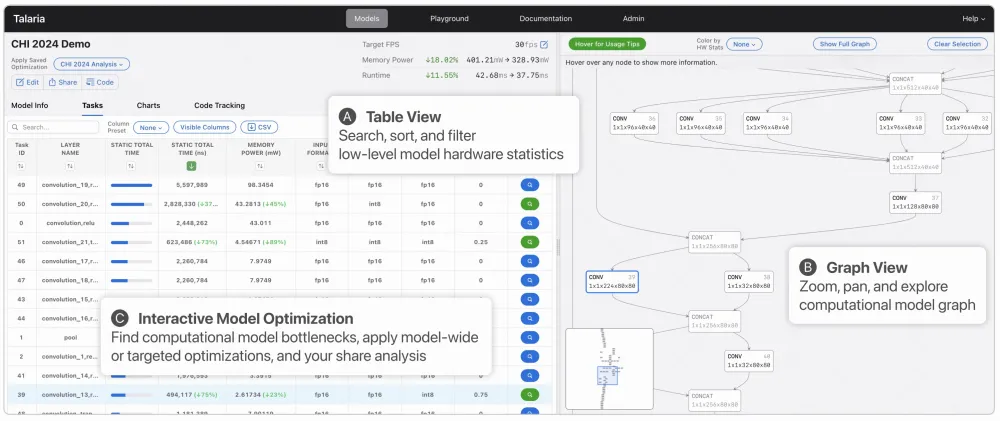

另外,為了保證 AI 模型的運作不至於大幅降低手機功耗,蘋果還配上了功耗分析工具 Talaria,及時優化功耗。

在這一系列操作之下,3B 模型的端側部署才成為了可能。

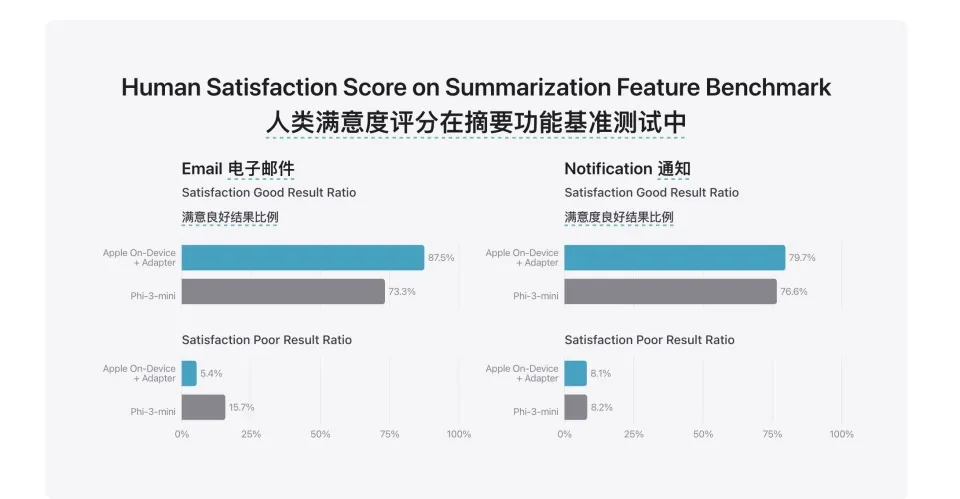

其次,在這篇技術部落格裡,蘋果也展示了他們如何去保障小模型的交付能力:不全能,但對具體任務做了加強。

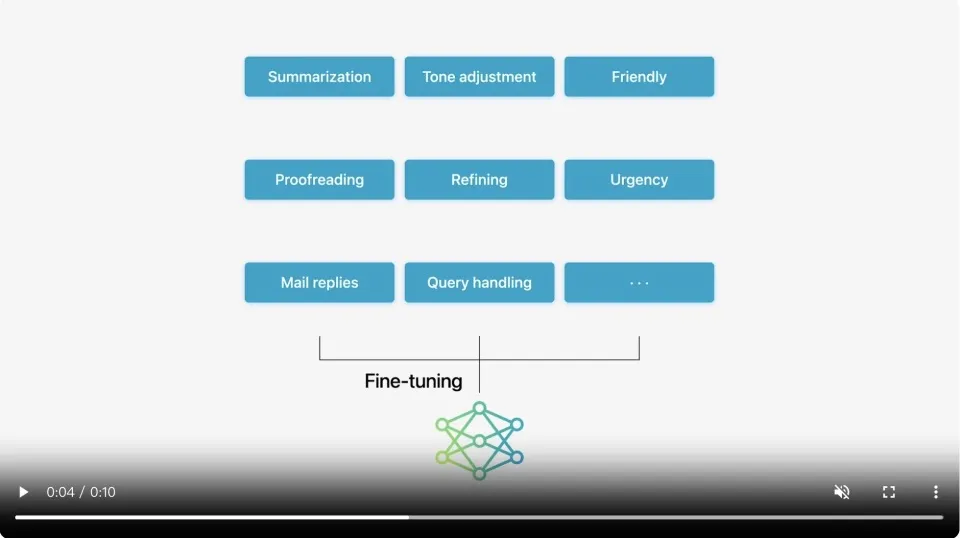

具體來講,蘋果在基礎模型上加了很多微調的適配器。適配器是疊加在通用基礎模型上的小型模型權重系列。它們可以動態加載和交換,使基礎模型能夠根據目前任務即時進行針對性特殊化處理。蘋果智慧包含一系列適配器,針對應急判斷,總結,郵件回複等諸多發布會上上的功能都進行了精細調優。

因此,至少端側模型可以較好的完成基本的摘要、寫郵件等最常見的工作。

綜合來看,蘋果在這次發布會上所展示出來的綜合模型能力基本可以說是遠超預期。從大模型到小模型都一躍進入了第一梯隊。

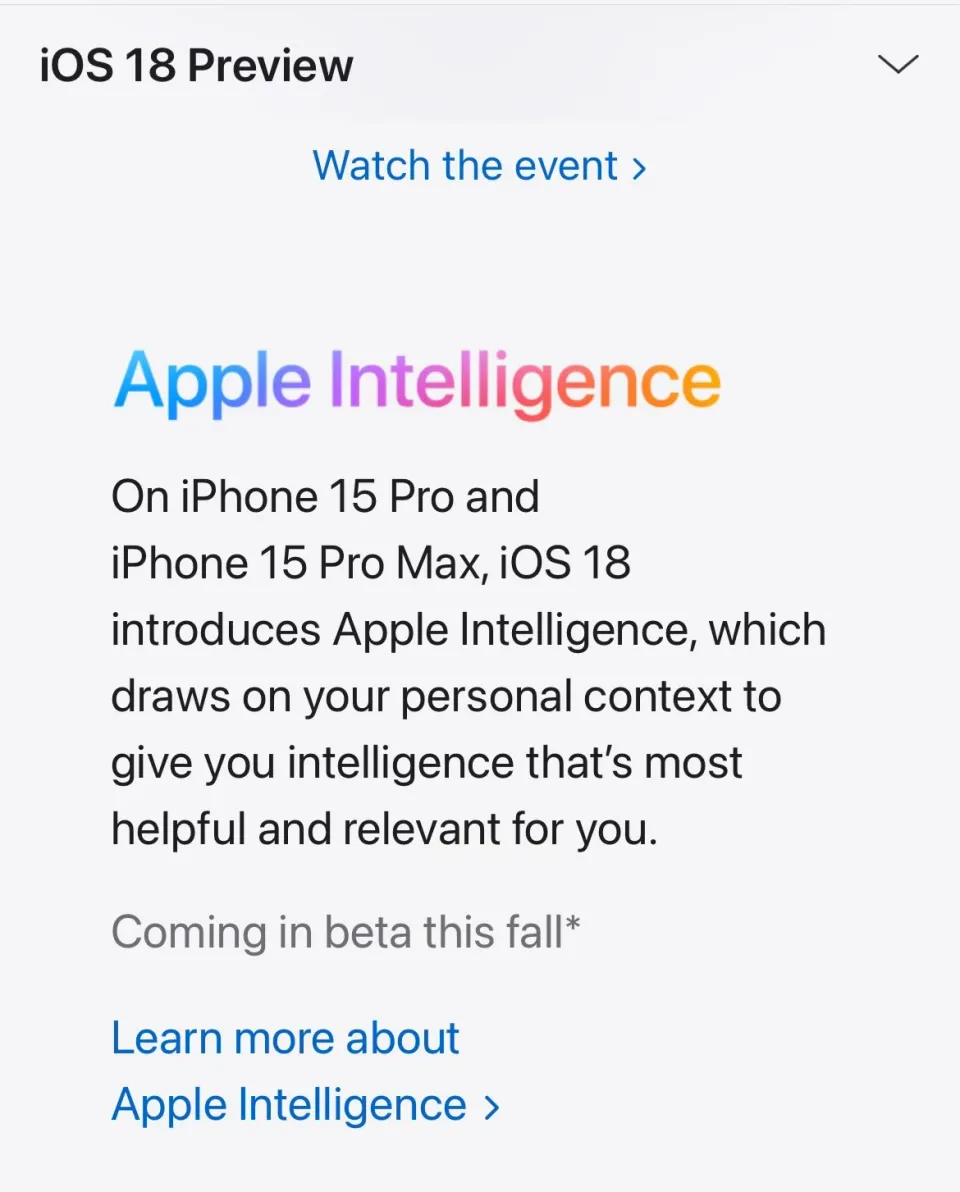

只有新旗艦才能用上的 AI,可能引發新的換機潮

另一個消息也很重要:雖然 iOS18 系統升級可以適用於 iPhoneX 以上的所有機型,但蘋果的 AI 功能只能適用在 iPhone 15 Pro 及以上機型,其它終端需要 M1 晶片以上的能力。這意味著為了能用上 AI,使用者可能必須要進行一波換機潮。

這其實也不是蘋果有意卡老使用者。端側大模型的運行瓶頸一方面是算力,一方面是內存。對蘋果來說,算力問題可能反倒不是那麼棘手。本次 Apple Intelligent 下放的產品從 M1 開始。M1 晶片負責 AI 推理的 NPU 能力其實還比不上 A16,但也足夠處理蘋果端側模型的推理需求了。那 iPhone14 Pro 乃至 iPhone 15 為什麼不行?還是因為內存不夠。

因為在模型進行推理過程中需要佔用很大的運行內存(DRAM),較小的內存會嚴重拖慢推理速度甚至無法完成推理。因此 iPhone 15 Pro 及以上的蘋果手機才有的 8G 內存,可能就是當下經過一系列優化的 3B 端側模型所需的最小內存數。

但這件事本身也有著優化的空間。昨天上交大發布的 PowerInfer2 手機推理架構就提出了進一步減小內存佔用的方法。GeminiNano 下放到 Pixel 8 也說明了 Google 也在做一樣的努力。

但內存需求小了,還有 7B,14B 的模型排隊等著上端。長遠來看,機還是不得不換。畢竟只有更大的端側模型才能帶來更多讓使用者買單的體驗魔法。

圓桌對話透露了和 OpenAI 的關係

既然蘋果自研的大模型能力如此強大,為何還要和 OpenAI 合作?蘋果公司的軟體工程高級副總裁克雷格-費德裡吉(Craig Federighi)和約翰-吉安南德雷亞(John Giannandrea) 在 Keynote 之後的閉門對話環節揭示了這個細節,騰訊科技在 WWDC 現場的同事發回了這場對話的內容記錄。 「現有的擁有豐富公共資訊的大語言模型,如 ChatGPT,也有其用途。這些非常大的前沿模型有一些使用者很喜歡的有趣功能,我們將其整合到我們的體驗中可以使用者體驗更豐富。」

考慮到這一點,Apple 在 WWDC 官宣了與 OpenAI 合作,在其平台上提供更強大的 AI 服務。然而,值得注意的是,OpenAI 的 ChatGPT 並沒有為 Apple Intelligence 提供支持,兩者完全獨立。Apple Intelligence 完全由 Apple 自研模型提供支持。

這就意味著,雖然 Apple 在 WWDC 現場官宣了和 OpenAI 的合作,但是這種合作並不是如外界猜測的,整合入蘋果系統中的。這種合作更像是和第三方大模型公司合作的一個範式,Federighi 解釋說 Apple 與 OpenAI 合作是因為 GPT-4o 目前是最好的 LLM,但 Apple 可能會在未來與其它 LLM 提供商合作,允許使用者選擇外部 LLM 提供商。SamAltman 的態度也很曖昧,一向高調的他,在「如此重要」的合作達成之後,僅僅發布了一條貼文。

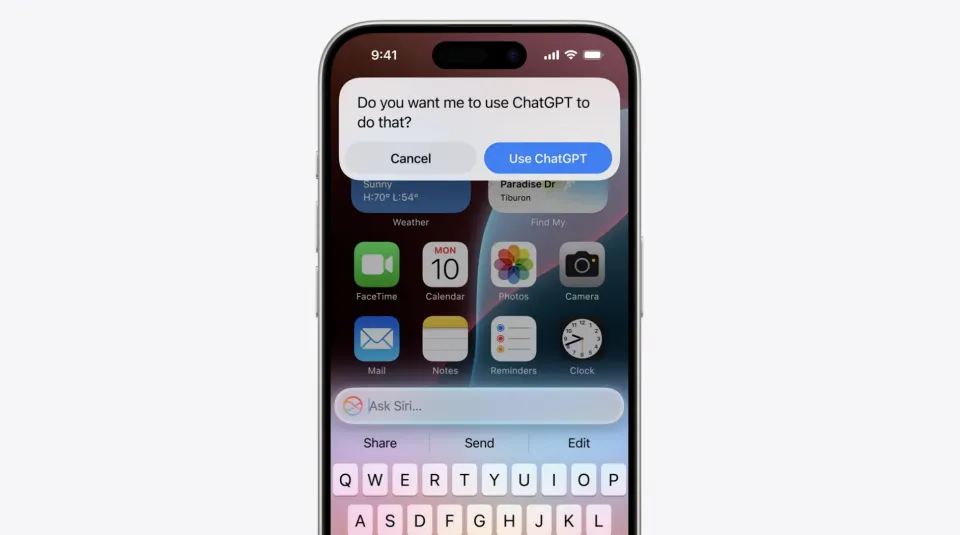

根據 Federighi 所說,Apple Intelligence 被設計為高度個性化的智慧,需要利用個人設備上的數據,如照片、聯係人、消息和電子郵件等,執行任務。當使用者有更複雜的 AI 請求時,OpenAI 的 ChatGPT 可以發揮作用。例如,某人可以使用他們的 Mac 或 iPhone 向 ChatGPT 發送查詢,如果他們希望 ChatGPT 為他們編寫電影劇本。

而且,Apple 在設計其與 ChatGPT 的整合時也採取了隱私優先的思維。未經使用者許可,任何使用者數據都不會發送到 OpenAI。在任何請求發送到 ChatGPT 處理之前,使用者必須首先手動允許。「例如,我是醫生,我可能希望將來引入一個醫療模型;我是律師,我可能有一個專為法律工作精煉的模型,我想將其引入我的個人設備中。 「蘋果認為這最終是將是對使用者在個人智慧方面所做工作的很好補充。」

通過與 OpenAI 的合作探路,未來蘋果是否會像今天打造 APP 生態一樣,繼續在 Apple 的設備上引入百花齊放的模型,為使用者提供無比個性化和智慧化的體驗?這些還是未知數,我們拭目以待。

打造未來的AI端側設備,蘋果有著先天的生態優勢

雖然蘋果在 WWDC 上展示的這些應用場景看起來並沒有多麼神奇,但是不得不說,這些確實是使用者實際應用中比較好的落地場景。比如 iPadOS 上筆記學習的功能,計算器全屏識彆的功能,iOS 上 Gen emoji 的能力等等,既有趣又有用。都是做應用,但是蘋果顯然做的更討巧,更容易被使用者深度的感知到。

在發布會後,騰訊科技主導的直播討論中,怒喵科技創辦人李楠就表示:「蘋果的端側模型具有系統級彆的權限和數據訪問能力。如果你問蘋果真的在 AI 能力上做到了什麼?它是全產業第一個真正把手機本地的 API 與端側模型無縫銜接的,並且是全產業第一個真正把使用者個人數據拿給端側模型進行 fine-tuning 的。彆的端側模型也想做這事兒,但是他們拿不到這些數據的訪問權限。蘋果的端側 AI 的核心技術能力一定會越來越強大。」

這種強大的本源力量來源於蘋果獨特的生態體係,這是安卓希望做而難以做到的,而蘋果可能是短時間內,能打通所有硬體設備終端設備 AI 體驗和流轉的,唯一的一家公司。

這無疑是蘋果這麼多年立足於科技產業頂端不曾跌落的重要的護城河。他們擁有極其堅實的生態壁壘,這不單單是產品和系統之間的,包括底層的晶片和開發工具,蘋果都可以做到完全的統一。

這幫助蘋果在端側 AI 時代,即便是後來者,也能提供前人無法實現的 AI 生態,甚至他們能提供更多的 AI 應用生態場景,比如此次 WWDC24 上,蘋果就展示了包括 AI 生成 emoji、AI 驅動的數學備忘錄等等讓人眼前一亮的功能,這相對於很多廠商還只在宣傳 AI 摳圖能力相比,顯然會更加有吸引力。

「我們希望人工智慧不是取代我們的使用者,而是增強他們的能力」。克雷格-費德裡吉在圓桌對話中談到蘋果對於 AI 的看法,「這與我們之前看到的人工智慧都不儘相同」。

但問題也隨之而來,蘋果或許將在未來無數次的證明一件事

和 OpenAI 的關係確定之後,隨之而來的問題是「蘋果如何將已存在的使用者數據交給第三方,完成 AI 生成內容的同時,保證它們的安全」。

這對於蘋果來說極其重要。

作為今年 WWDC 最重要的產品,克雷格・費德里吉(Craig Federighi)在發布 Apple Intelligence 的時候,用了很重的篇幅去試圖告訴使用者,Apple Intelligence 所打造的這種「端+私有雲端」對組合方式,是多麼的安全。蘋果通過系統級的安全晶片加密,以及完全封閉的傳輸路徑,去保證這一點……

蘋果在主題演講中著重提及了這部分的流程,他們在系統中增加了一個開關,所有輸出到 GPT-4o 的內容,都一定是使用者主動發起確認的內容。

同時克雷格也在圓桌上表示蘋果處理使用者需求的過程,如果要上雲端,他們擁有一套獨立的加密演算法,使用者數據脫敏,處理之後數據會隨即銷毀,蘋果對於這個過程中的數據是完全無法干預的。

蘋果希望通過這樣的方式方法,去告訴使用者這足夠安全。甚至他們還找到了一些獨立的安全研究人員,開放給他們 Apple Intelligence 的伺服器,引入第三方去幫助他們證明使用者數據的安全是不會被洩露的。

但這依然沒能消除外界對於隱私數據安全外洩的擔憂,尤其是在 Siri 接入到 GPT-4o 之後,使用者數據如何脫敏、如何在蘋果-OpenAI-蘋果的這條傳輸路徑中不走錯路口等等問題,都一股腦的拋向了蘋果。

面壁智慧首席研究員韓旭在和騰訊科技的解讀直播中也表示了擔憂,他認為只要數據從蘋果傳給了第三方,無論是 OpenAI 的 GPT 還是 Google 的 Gemini,蘋果可能都將會失去對於數據安全的控製權,這確實會對蘋果的隱私安全提出新的挑戰。

但好消息是,這並不是蘋果第一次面臨這樣的問題。

蘋果在選擇搜尋供應商的時候,曾經陷入過類似的討論。當蘋果將 Google 確認為 iPhone 默認的(海外)搜尋引擎時,曾經就被質疑如何保證使用者的隱私數據不被洩露。庫克在接受外媒專訪時,闡述的內容和如今他們選擇 OpenAI 出奇的一致。

蘋果選擇 Google,庫克表示 Google 在搜尋引擎這一方面是做的最好的。

蘋果選擇 OpenAI,克雷格也表示目前 OpenAI 是蘋果最好的選擇。

庫克在談及搜尋引擎時,表示蘋果也在其中融入了很多的控製選項,如在 Safari 瀏覽器中開發了隱私瀏覽模式,並配有智慧防追蹤器等,來為使用者提供全方面的幫助。

而克雷格在談及 AI 時,更多的還只聊到了他們在端側+私有雲端的加密策略,但對於 OpenAI 的部分,顯然還沒有透露更多。

或許可以預見,在未來的很長一段時間裡,蘋果都會無數次的證明,自己的 AI 策略是安全的,包括自己的和第三方的,這對於蘋果這家公司來說,是紅線。

【免責聲明】市場有風險,投資需謹慎。本文不構成投資建議,使用者應考慮本文的任何意見、觀點或結論是否符合其特定狀況。據此投資,責任自負。

- 本文經授權轉載自:《MarsBit》

- 原文作者:郝博陽、郭曉靜、吳彬, 騰訊科技

・ 本文未經同意請勿轉載

市場有風險,投資需謹慎。本文不構成投資建議,使用者應考慮本文的任何意見、觀點或結論是否符合其特定狀況。據此投資,責任自負。

你可能想知道